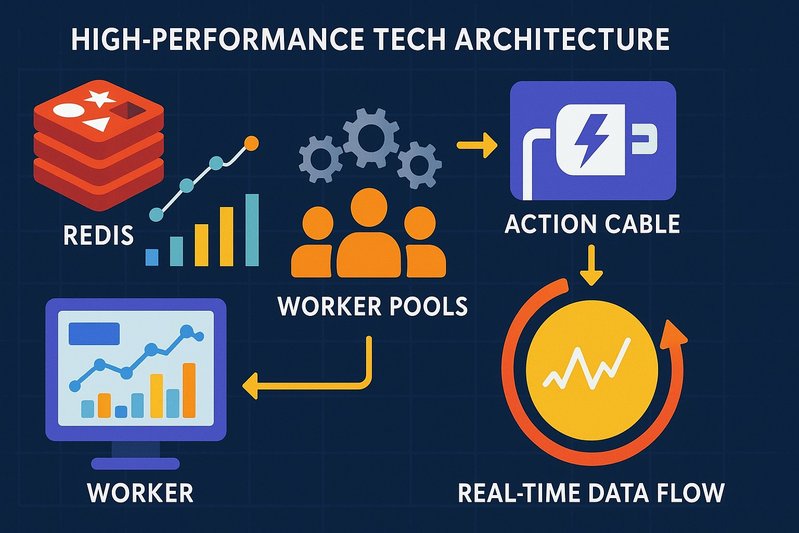

Action Cable soutenu par Redis et des pools de travailleurs optimisés pour des performances déterministes en temps réel dans Rails 7.1+

Rails en temps réel ne se contente plus d’être “tout juste”; il est rapide, prévisible et opérationnellement mature lorsqu’il est configuré avec intention. Activer permessage-deflate et les cadres compressibles réduit leur charge de bande passante de 40 à 80 %; ajuster un pool de travailleurs Action Cable sous-dimensionné et le débit grimpe de 1,5 à 3× avec un p95/p99 plus propre; passer de PostgreSQL LISTEN/NOTIFY à Redis pub/sub et la capacité de fan-out multinodes augmente de 3 à 10×. Ce ne sont pas des gains marginales. Ils sont le résultat naturel de Rails 7.1+ s’appuyant sur un modèle réacteur-plus-pool-de-travailleurs simple, un adaptateur Redis renforcé, et une ergonomie Hotwire/Turbo Streams qui déplace le rendu coûteux hors du chemin critique.

Cette plongée technique explique comment l’architecture d’Action Cable se traduit en une discipline de latence de queue, ce que l’adaptateur Redis offre en pratique, et pourquoi LISTEN/NOTIFY reste de niche. Elle passe en revue le chemin de déchargement …_later de Turbo Streams, les compromis de compression WebSocket, et les réalités de la pression arrière et des consommateurs lents. Elle couvre également la justesse du cycle de vie des abonnements, les modèles d’efficacité côté client, et comment interpréter la latence p50/p95 et les plafonds de débit pour éviter de courir après le mauvais goulot d’étranglement. Attendez-vous à des exemples de configuration concrets et à des tableaux qui rendent les compromis explicites.

Détails de l’architecture/implémentation

Le modèle réacteur-thread et pourquoi il dompte la latence de queue

Action Cable sépare clairement les préoccupations: une boucle d’E/S WebSocket non bloquante gère les cadres, tandis qu’un pool de travailleurs Ruby exécute les rappels de canal—abonné, désabonné, effectuer—et traite les messages entrants. Le pool de travailleurs par défaut est intentionnellement petit (communément autour de 4), ce qui est favorable aux petites applications mais une responsabilité sous une diffusion intense. Lorsque le pool est sous-dimensionné, les files d’attente de travaux s’accumulent, et les latences p95/p99 gonflent malgré un réacteur d’E/S apparemment inactif.

flowchart TD;

A[Boucle d'E/S WebSocket] -->|gère| B[Cadres];

A --> C[Pool de Travailleurs];

C -->|exécute| D[Rappels de Canal];

D --> E[Messages Entrants];

C -->|engendre| F[Threads];

F -->|traite| G[Files de Travaux];

G --> H[Latence de Queue];Ce diagramme représente le modèle réacteur-thread d’Action Cable, illustrant comment la boucle d’E/S WebSocket interagit avec les pools de travailleurs, exécute les rappels de canal, et traite les messages entrants pour gérer la latence de queue efficacement.

Dimensionnez correctement le pool, et la latence de queue redevient prévisible. Augmenter un pool trop petit à 8–16 threads produit généralement une augmentation du débit de 1,5 à 3× et réduit p95 jusqu’à ce que la prochaine contrainte (CPU, Redis ou NIC) soit atteinte. Cependant, le surdimensionnement est contre-productif: la contention des threads augmente et les points d’extrémité HTTP situés sur le même serveur peuvent être affamés si Action Cable partage un cluster Puma.

La configuration est simple:

# config/environments/production.rb

config.action_cable.worker_pool_size = 8Associez cela à un Puma judicieusement approvisionné—travailleurs ≈ cœurs CPU, 8–16 threads par travailleur, preload_app!—et vous obtiendrez une concurrence prévisible pour les charges mixtes HTTP + WebSocket. De nombreuses équipes isolent également Action Cable dans son propre Puma pour éviter les interférences lors des pics en temps réel.

Redis pub/sub: ce qu’il offre (et ce qu’il n’offre pas)

L’adaptateur de souscription Redis est la voie de production pour Action Cable multi-nodes. Il utilise Redis pub/sub pour la coordination inter-processus, prend en charge TLS et l’authentification via URL, et présente un comportement de reconnexion bien compris. Avec un Redis dédié pour le trafic pub/sub, la latence de publication à réception est généralement de l’ordre de quelques millisecondes avec une faible variance; 10k+ messages par seconde entre les nœuds est courant avant que le CPU ou les NIC ne deviennent les limitateurs. Critiquement, Redis évite la limite de charge utile d’environ 8 Ko de PostgreSQL NOTIFY et ne consomme pas le pool de la base de données de votre application, c’est pourquoi la capacité de fan-out pour les charges moyennes/grandes augmente d’un facteur d’environ 3–10× dans les configurations multi-nodes.

Sur le plan opérationnel, une défaillance ou des partitions de réseau feront tomber les abonnements; l’adaptateur se réabonne à la reconnexion. Utiliser les keepalives TCP, des délais d’attente de client appropriés, et une instance dédiée améliore la récupération et empêche les tempêtes de reconnexion. Des garanties de livraison spécifiques au-delà des sémantiques pub/sub ne sont pas détaillées ici; traitez Redis pub/sub comme un fan-out à grande vitesse, au mieux, plutôt qu’une file d’attente durable.

Activez-le avec:

# config/cable.yml

production:

adapter: redis

url: <%= ENV["REDIS_URL"] %>

channel_prefix: myapp_productionPostgreSQL LISTEN/NOTIFY: adapté, mais étroit

LISTEN/NOTIFY maintient une connexion persistante à la base de données par processus serveur, se dispute le pool DB sous la charge, et limite les charges utiles à environ 8 Ko. La latence et le débit conviennent pour des déploiements petits ou à nœud unique avec une diffusion modeste et de petits messages. Au-delà, le couplage opérationnel à la base de données et la limite de charge utile en font un mauvais choix pour une diffusion en temps réel à grande échelle. Le chemin est simple—définir adapter: postgresql—mais le plafond arrive vite; la plupart des systèmes de production bénéficient de Redis.

Turbo Streams: décharger le rendu pour protéger le chemin critique

Les Turbo Streams rendus côté serveur réduisent la complexité CPU et JavaScript côté client en fournissant des opérations DOM déclaratives. Mais rendre ERB sur le chemin critique de WebSocket peut bloquer le réacteur lorsque les mises à jour augmentent ou que le fan-out monte. Les aides …_later résolvent cela en déplaçant le rendu vers les tâches d’arrière-plan:

class Message < ApplicationRecord

after_create_commit -> { broadcast_append_later_to "room_#{room_id}" }

endCe changement améliore matériellement la latence de queue dans des scénarios de fan-out 1:100+ en plein essor. Attendez-vous à une réduction de 20 à 50 % de p95 lorsque des parties importantes sont rendues via les variantes …_later, échangeant le blocage de la tête de ligne contre une latence de file de tâches qui est généralement plus petite et plus facile à absorber.

Compression: l’espace de compromis bande passante/CPU de permessage-deflate

Lorsque les deux extrémités le prennent en charge, le websocket-driver sous-jacent négocie automatiquement permessage-deflate—aucun changement d’application requis. Pour les cadres compressibles comme JSON ou HTML turbo-stream, la bande passante diminue de 40 à 80 %, ce qui augmente souvent le nombre de messages durables par seconde de 10 à 30 % avant que qu’une autre limite n’intervienne. Le surcoût CPU est modeste pour de petits messages et augmente avec des cadres plus grands (par exemple, autour de 32 Ko), alors mesurez avant et après. Si la négociation échoue ou si un client ne prend pas en charge l’extension, la connexion se poursuit sans compression, sans interruption.

Pression arrière et consommateurs lents sur WebSocket/TCP

Le TCP applique une pression arrière. Si les tampons d’envoi du noyau se remplissent, les écritures ralentissent, et les consommateurs lents peuvent créer un blocage de la tête de ligne qui se propage. Action Cable n’applique pas de limitation de taux au niveau de l’application, alors ajoutez des garde-fous pour les événements entrants et limitez la quantité de travail par message. Un modèle simple utilise des compteurs Redis pour réguler:

def perform(action, data)

key = "cable:ratelimit:#{current_user.id}:#{action}:#{Time.now.to_i}"

if Redis.current.incr(key) > 5

reject

else

Redis.current.expire(key, 1)

# traite le message

end

endDu côté de la sortie, préférez des mises à jour petites et compressibles, déplacez le rendu lourd vers …_later, et surveillez les canaux dont les consommateurs sont constamment en retard—ceux-ci sont des candidats pour le coalescement ou l’échantillonnage.

Justesse du cycle de vie des abonnements et coût de reconnexion

Une gestion correcte du cycle de vie maintient l’utilisation des ressources prévisible et les reconnexions peu coûteuses:

- Appelez stop_all_streams dans désabonné pour éviter les abonnements persistants.

- Gardez l’autorisation de connexion légère—cookies signés et recherche utilisateur unique—afin que les tempêtes de reconnexion ne frappent pas votre base de données.

- Ajustez les délais d’inactivité des proxies/équilibreurs de charge avec l’intervalle de ping du serveur (souvent à 60 secondes ou plus) et activez les sessions persistantes. Des délais d’inactivité trop courts coupent les sockets inactifs et déclenchent des boucles de reconnexion évitables.

Tableaux de comparaison

Adaptateurs Redis vs PostgreSQL pour le fan-out Action Cable

| Dimension | Adaptateur Redis pub/sub | PostgreSQL LISTEN/NOTIFY |

|---|---|---|

| Limites de charge utile | Pas de limite d’adaptateur typique pour pub/sub | ~8 Ko limite de charge utile NOTIFY |

| Fan-out entre nœuds | Élevé; marge de 3–10× par rapport à PG à grande échelle | Limité; concurrence avec le pool DB |

| Variance de latence | Faible lorsque Redis est dédié | Variance plus élevée sous la charge DB |

| Couplage des ressources | Requiert une instance Redis dédiée | Consomme une connexion DB par processus serveur |

| Comportement de reconnexion | Sémantiques de réabonnement stables; configurer les keepalives/délais | Lié à la stabilité de la connexion DB |

| Adaptation opérationnelle | Production multi-nodes; charges moyennes/grandes | Petites applications, faibles échelles ou nœuds uniques |

Fonctions qui font la différence

| Levier | Impact typique | Mises en garde |

|---|---|---|

| Augmenter worker_pool_size de ~4 à 8–16 | Débit de 1.5–3×; p95/p99 réduit jusqu’au CPU/Redis/NIC saturent | Surdimensionner peut aggraver p95 et nuire à la latence HTTP si partage de Puma |

| Utiliser les aides Turbo Streams …_later | -20–50% p95 dans le fan-out 1:100+ en plein essor avec des parties lourdes | Ajoute la latence de la file de tâches; assurer la santé des tâches d’arrière-plan |

| Activer permessage-deflate | -40–80% de bande passante; +10–30% de messages durables/sec | Le coût CPU augmente avec les grands cadres; mesurer avant/après |

| Passer de PG à l’adaptateur Redis | Marge de fan-out de 3–10× plus élevée; évite la concurrence du pool DB | Nécessite Redis dédié et discipline de basculement |

Bonnes pratiques

Façonner la concurrence autour de votre CPU et charge de travail

- Commencez avec worker_pool_size à 8–16 lorsque la marge CPU existe, puis ajustez en utilisant des métriques de latence et de débit réelles.

- Dans Puma, utilisez workers≈cores, threads 8–16, et preload_app!. Si les points d’extrémité HTTP souffrent pendant les pics en temps réel, isolez Action Cable dans son propre Puma.

Rendre les diffusions petites, compressibles, et hors du chemin critique

- Utilisez Turbo Streams pour les changements DOM rendus côté serveur; préférez les variantes …_later pour les mises à jour lourdes de rendu.

- Coalescez ou échantillonnez les pics lorsque le même flux reçoit des mises à jour fréquentes.

- Gardez les charges utiles compressibles (extraits JSON, HTML) pour profiter de permessage-deflate.

Traitez Redis comme un transport de première classe

- Exécutez un Redis dédié pour le trafic pub/sub; évitez de le mélanger avec des charges lourdes de clé/valeur ou des configurations fsync inutiles.

- Configurez TCP keepalive et les délais d’attente des clients pour accélérer la détection des défaillances.

- Surveillez l’utilisation du CPU et du réseau Redis en même temps que les métriques de l’application.

Renforcez le bord

- Configurez l’équilibreur de charge pour passer Upgrade: websocket, activez les sessions persistantes, et réglez les délais d’inactivité au-dessus de l’intervalle de ping.

- Surveillez les taux de reconnexion; les pics inattendus remontent souvent aux délais d’inactivité ou aux redéploiements LB.

Intégrez le contrôle de flux et les garde-fous

- Limitez le taux des événements entrants en utilisant les compteurs Redis ou les modèles de middleware.

- Gardez le travail de canal par message petit; les opérations lourdes appartiennent aux tâches d’arrière-plan.

- Suivez les consommateurs lents et ajustez les stratégies de diffusion selon les besoins.

Observez ce qui compte et ajustez de manière itérative

- Abonnez-vous aux notifications Active Support pour les durées par canal et par action, les profondeurs de file, les comptes de connexions et les erreurs.

- Ajoutez une traçabilité autour des actions de performance du canal et des appels de diffusion; corrélez avec l’instrumentation du client Redis pour localiser la latence.

- Validez tout changement d’ajustement en comparant la latence p50/p95, les msgs/sec livrés à un taux d’erreur/abandon fixe, la bande passante sortante, et les taux de reconnexion.

Gardez le cycle de vie et l’authentification bon marché

- Assurez-vous que stop_all_streams s’exécute dans désabonné pour éviter les fuites.

- Utilisez des cookies signés/encryptés et une récupération d’utilisateur mise en cache sur la connexion; évitez les vérifications de base de données par message.

- Restreignez allowed_request_origins pour réduire les frais de négociation et la surface d’abus.

Exemples pratiques

# config/environments/production.rb

# Commencez prudemment, puis affinez avec des métriques

config.action_cable.worker_pool_size = 12# config/cable.yml

production:

adapter: redis

url: <%= ENV["REDIS_URL"] %> # supporte TLS/auth via URL

channel_prefix: myapp_production# Turbo Streams: déchargez le rendu lourd

class Message < ApplicationRecord

after_create_commit -> { broadcast_append_later_to "room_#{room_id}" }

end# Instrumentation pour les métriques

ActiveSupport::Notifications.subscribe(/action_cable/) do |name, start, finish, id, payload|

duration_ms = (finish - start) * 1000

# exporte les comptes, durées, échecs, statistiques par canal

end// Client @rails/actioncable avec des paramètres par défaut raisonnables

import { createConsumer } from "@rails/actioncable"

const consumer = createConsumer("wss://example.com/cable")

const channel = consumer.subscriptions.create(

{ channel: "RoomChannel", id: 42 },

{

connected() { /* prêt */ },

disconnected() { /* backoff automatique & réessayer */ },

received(data) {

// Regrouper les mises à jour DOM dans la mesure du possible

requestAnimationFrame(() => {

// appliquer mise à jour (ou laisser Turbo Streams le faire)

})

}

}

)Interprétation des performances: p50/p95, plafonds de débit, et décalages de goulot d’étranglement

Concentrez-vous sur les changements qui améliorent les messages livrés à un taux d’erreur/abandon fixé sans déstabiliser le comportement de reconnexion:

- Suivez la latence de connexion à réception (intégrez les horodatages du serveur dans les charges utiles) et calculez p50/p95. Attendez-vous à ce que p95 se resserre à mesure que vous augmentez worker_pool_size à partir d’une base sous-dimensionnée et que vous déplacez le rendu vers …_later.

- Mesurez les msgs/sec livrés sous des charges stables et en plein essor. La compression permet souvent 10–30% de débit en plus avant que la prochaine limite ne se manifeste.

- Surveillez la bande passante sortante. Avec permessage-deflate, la bande passante diminue généralement de 40 à 80 % sur les cadres compressibles; cela se traduit par une utilisation plus faible du NIC et plus de marge de manœuvre.

- Surveillez le CPU des nœuds d’application et Redis. Au fur et à mesure que vous éliminez les goulots d’étranglement (par exemple, saturation du pool de travailleurs), le suivant émergera—généralement le CPU ou le réseau, parfois Redis lui-même.

- Suivez les taux de reconnexion pendant les opérations normales et les défaillances induites (redémarrage de Redis, drainage LB). Des keepalives/délais appropriés et des sessions persistantes réduisent les pics de reconnexion et raccourcissent la récupération.

Utilisez cette boucle pour ajuster vers vos SLO: augmentez le pool de travailleurs jusqu’à ce que le CPU approche des limites sûres; déplacez le rendu hors du chemin critique; activez la compression; confirmez que Redis n’est pas encombré; et réexaminez les délais de l’équilibreur de charge. Attendez-vous à des gains progressifs—chaque amélioration déplacera le goulot d’étranglement, sans l’éliminer.

Conclusion

Rails 7.1+ offre à Action Cable une recette pragmatique pour des performances déterministes en temps réel: maintenez l’I/O non bloquant, poussez le travail dans un pool de threads correctement dimensionné, comptez sur Redis pub/sub pour le fan-out entre nœuds, et utilisez Turbo Streams pour déplacer le rendu lourd hors du chemin critique. La compression WebSocket étire la bande passante, et une gestion disciplinée de la pression arrière garde les consommateurs lents de nuire. Le playbook opérationnel—sessions persistantes, délais d’inactivité raisonnables, un Redis dédié, et métriques via les notifications Active Support—transforme ces blocs de construction en p95/p99 prédictibles et un comportement sain de reconnexion à grande échelle.

Points clés à retenir:

- Ajustez d’abord le pool de travailleurs Action Cable; cela apporte souvent les plus grandes améliorations de p95/débit.

- Préférez Redis pub/sub pour les fan-out multi-nodes; LISTEN/NOTIFY reste une option à petite échelle en raison des limites de charge utile et du couplage DB.

- Déplacez les diffusions lourdes en rendu vers …_later; cela protège le réacteur et resserre la latence de queue.

- Activez permessage-deflate pour échanger un CPU modeste contre des gains significatifs en bande passante et débit.

- Mesurez sans relâche: p50/p95, msgs/sec livrés, bande passante sortante, CPU Redis et app, et taux de reconnexion.

Prochaines étapes pour les équipes:

- Testez votre configuration actuelle, puis augmentez worker_pool_size avec la marge CPU et mesurez à nouveau.

- Migrez vers l’adaptateur Redis si vous utilisez encore LISTEN/NOTIFY.

- Auditez les diffusions Turbo Streams et déplacez les lourdes vers les variantes …_later.

- Vérifiez la négociation permessage-deflate et les paramètres de session persistante/timeout de LB.

- Structurez les événements Action Cable et ajoutez des tracés pour corréler la latence de l’application, Redis, et du réseau.

Avec ces pratiques en place, Rails en temps réel s’étend à des milliers de connexions simultanées et des taux de messages élevés tout en maintenant une latence nette et constante—sans exploits héroïques requis. 🚀