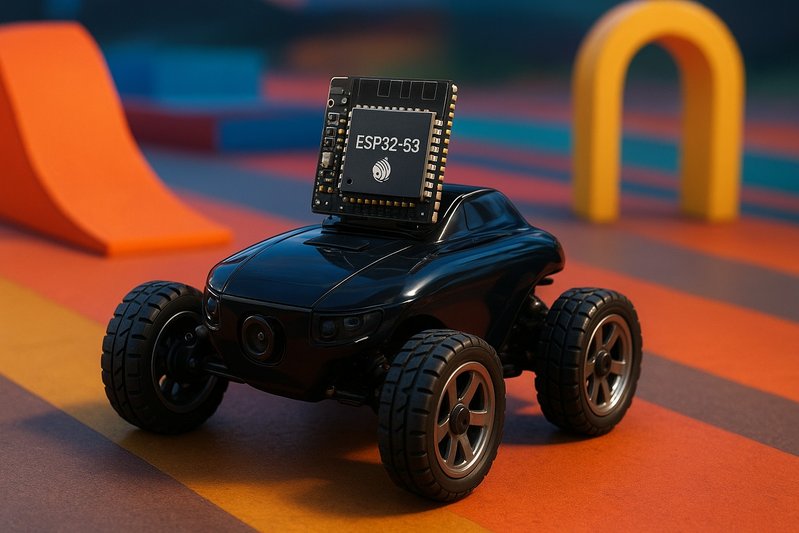

ESP32‑S3 Permet la Détection d’Obstacles en Temps Réel de 50 à 100 ms pour les Rovers à Petit Budget

Sous-titre: Un guide 2026 pour ESP‑IDF/FreeRTOS: télémétrie 1D + fusion légère comme cœur de sécurité, vision QQVGA optionnelle sur S3, et un protocole standardisé rendant les résultats reproductibles

En 2026, les rovers à petit budget n’ont plus à choisir entre abordabilité et détection rapide et fiable des obstacles. Les microcontrôleurs de la classe ESP32—surtout l’ESP32‑S3—atteignent désormais la barre du temps réel sous 100 ms avec des capteurs disponibles sur étagère, des algorithmes pragmatiques et un protocole d’évaluation qui transforme les anecdotes en chiffres comparables. La recette est peu glamour mais efficace: installer un capteur de distance à haute fréquence à la pointe, élargir la couverture avec des ultrasoniques angulaires, fusionner les preuves à travers les secteurs avec un timing serré et, sur S3, ajouter une petite caméra pour la vision classique QQVGA ou le tiny-ML pour détecter les objets en verre et minces. Le résultat est une pile robuste et reproductible, évolutive des kits pédagogiques à faible coût aux coureurs de couloir imprimés en 3D capables de 1,5 à 2,0 m/s avec des marges d’arrêt mesurées.

Pourquoi le Matériel de Classe ESP32 Passe Maintenant la Barre du Temps Réel

Deux changements rendent possible la détection de bout en bout de 50 à 100 ms sur la famille ESP32. Premièrement, les latences des capteurs sont courtes et prévisibles. Un LiDAR 1D TF‑Luna fonctionne à 100–250 Hz avec une latence de détection d’environ 4 à 10 ms; le ToF VL53L1X de ST peut fonctionner avec des budgets temporels de 20–33 ms; les ultrasoniques sont limités à quelques microsecondes de temps de vol par mètre. Deuxièmement, la chaîne d’outils et les périphériques de l’ESP32‑S3 éliminent les goulets d’étranglement du CPU: les instructions SIMD/NN accélèrent le tiny-ML via ESP‑NN; le périphérique LCD_CAM avec DMA décharge la capture parallèle de la caméra; les PSRAM largement disponibles augmentent l’espace tampon tout en hébergeant encore les données chaudes dans la SRAM.

L’ESP32 classique reste une base solide à double cœur pour la télémétrie et la fusion à haute fréquence. L’ESP32‑C3, une partie RISC‑V monocœur, gère de manière fiable les pipelines multi-capteurs légers, mais manque d’un chemin caméra parallèle et de la marge pour la vision en temps réel. Sur S3, la CV classique sur QQVGA/QVGA et les micro-CNN en int8 à 96×96–160×160 atteignent des dizaines de millisecondes par frame, en gardant les boucles complètes dans la plage de 50–100 ms lorsque l’exposition et le traitement sont contrôlés.

Les périphériques comptent. RMT fournit des déclencheurs ultrasoniques microsecondes et des captures d’écho avec faible gigue. PCNT et MCPWM offrent un contrôle précis de l’odométrie et des moteurs pour les essais de freinage. Les horodatages esp_timer prennent en charge la journalisation à granularité microseconde. Sur S3, LCD_CAM et esp32‑camera DMA gardent le CPU concentré sur la perception, pas les pixels—une distinction essentielle lorsque chaque milliseconde grignote la distance d’arrêt.

L’Architecture de Capteurs Qui Répond aux Objectifs de Latence, de Couverture et de Robustesse

Le cœur d’une architecture robuste à faible latence est une télémétrie rapide et étroite vers l’avant, avec une redondance FoV large:

- Télémétrie vers l’avant: Le Benewake TF‑Luna à 100–250 Hz (4–10 ms de détection à ces taux) offre la meilleure combinaison de vitesse, portée (0,2–8 m) et robustesse, communiquant sur UART/I2C. Comme option à moindre coût, le VL53L1X maintient des budgets temporels de 20–33 ms avec un FoV configurable et jusqu’à environ 4 m en intérieur.

- Couverture large: Les ultrasoniques angulaires HC‑SR04 ou JSN‑SR04T‑2.0 fournissent un faisceau plus large (≈15° typique) pour combler les angles morts. Ils excellent à courte distance, avec une latence d’écho par mètre de seulement quelques millisecondes, mais nécessitent des contrôles d’interférences et des débouncing.

- Redondance de proximité: Les capteurs de proximité IR analogiques peu coûteux (par ex. plage de 10–80 cm) servent de détecteurs de dernier recours mais sont sensibles à l’IR ambiant et à la réflectance de surface, ils ne peuvent donc pas ancrer une boucle de sécurité.

- Vision optionnelle: Une caméra OV2640 en QQVGA/QVGA (niveaux de gris) sur S3, alimentée via LCD_CAM/I2S DMA, complète la détection 1D. Elle peut mettre en évidence les surplombs, les bords de panneaux de verre, et les obstacles fins qui défient les ultrasoniques et le ToF. Les pipelines de caméra de bout en bout se situent généralement entre 50–120 ms selon le taux de trame, l’exposition, et la complexité de l’algorithme/modèle.

Les modes de défaillance diffèrent selon la modalité. Les ultrasoniques peuvent déclencher de faux positifs par interférences croisées et manquer les surfaces molles ou très angulaires; le ToF et le LiDAR 1D peuvent avoir des difficultés sur le verre et les matériaux très sombres à de longues distances ou sous un fort ensoleillement; les caméras ont des problèmes en faible luminosité et avec le flou de mouvement. Fusionner les géométries et les caractéristiques d’erreur complémentaires est le compromis pragmatique.

Algorithmes Adaptés à l’Appareil: Seuils, Occupation, Fusion, et Vision Légère

Les victoires les plus rapides commencent simple:

- Seuils avec hystérésis: Sur les capteurs de télémétrie à haute fréquence, les seuils débouncés réagissent en quelques millisecondes à quelques dizaines de millisecondes. C’est aussi rapide que le capteur le permet et cela consomme un CPU négligeable. Les filtres médian/vote atténuent les bruits des cas isolés.

- Occupation sectorielle: Trois à cinq capteurs fixes inclinés pour couvrir ±60° à ±90° peuvent remplir une grille d’occupation de 12–24 secteurs à chaque cycle. Chaque mesure met à jour les probabilités d’occupation avec une courte décroissance temporelle. La charge de calcul est minime—environ 1–3 ms par cycle—et le contexte angulaire améliore tant les décisions d’arrêt que la sélection de trajectoire.

- Fusion légère: Des filtres alpha-bêta par secteur ou une simple mise à jour bayésienne stabilisent la perception à travers les matériaux et les fausses alertes sporadiques, surtout en combinant ultrasonique, ToF/LiDAR, IR, et odométrie des roues. Les implémentations avec des primitives ESP‑DSP ajoutent environ 1–3 ms par boucle de 50–100 Hz pour une grille de 12–24 secteurs.

Sur ESP32‑S3, la vision est un complément intelligent:

- CV Classique: Avec capture DMA, réduction en niveaux de gris, et gradients rapides, S3 exécute des contours, des différences de trame, ou un flux optique grossier sur des frames de 160×120 à 320×240 en environ 10–50 ms de calcul, permettant des boucles de bout en bout à l’intérieur de 50–100 ms lorsque les paramètres de la caméra sont optimisés pour une faible latence.

- Tiny‑ML: Les micro-CNN en int8 à 96×96–160×160—tels que les classificateurs d’obstacles binaires ou les détecteurs de centroides de type FOMO—peuvent inférer en environ 20–90 ms sur S3 lorsqu’accélérés par ESP‑NN. L’ESP32 classique est généralement 1,5–3× plus lent pour les CNN, ajustant les modèles et les taux de frame à la baisse; l’ESP32‑C3 est généralement inapproprié pour la vision en temps réel au-delà des très petits classificateurs à faibles taux.

La vision ne doit pas remplacer la couche d’arrêt 1D; elle comble les cas limites comme le verre, les poteaux fins et les surplombs.

De la Latence à la Vitesse de Sécurité: Modélisation et Chiffres Pratiques

Le fonctionnement sécurisé est un problème mathématique, pas une question de ressenti. Une règle conservatrice est:

D_detect ≥ v · T_latency + D_brake(v) + marge

Où D_detect est une distance de détection fiable au 95ème centile, T_latency est la latence de perception de bout en bout, et D_brake(v) est la distance de freinage à partir de la vitesse v, plus une marge. En pratique:

- Avec le TF‑Luna à 100 Hz et 10–15 ms de détection de bout en bout et de latence de décision, et une décélération du rover autour de 1,5 m/s², des vitesses de 1,5–2,0 m/s sont faisables dans des couloirs intérieurs avec une marge de 0,5 m, en supposant une détection fiable d’environ 0,25–6 m selon le matériau et la géométrie.

- Avec le VL53L1X à des budgets temporels de 20–33 ms, des vitesses maximales proches de 1,0–1,5 m/s sont réalistes sous des marges similaires.

- Les piles uniquement ultrasoniques devraient viser des vitesses plus faibles et des marges plus grandes en raison de la longueur de la zone aveugle, de la géométrie du faisceau, et des taux de manque sur les obstacles angulaires/mous.

Ce ne sont pas des promesses en l’air—ce sont des points de départ à valider sur la géométrie de votre rover, sa masse, ses pneus, son contrôleur, et ses surfaces. Le bon protocole (ci-dessous) relie les chiffres à la réalité.

Modèles d’Implémentation dans ESP‑IDF/FreeRTOS Qui Respectent les Délais

Atteindre les cibles en temps réel sur les microcontrôleurs est autant un problème de planification et d’E/S qu’un problème algorithmique:

- Graphe de tâches et affinité des cœurs: Sur les parties à double cœur, épinglez la télémétrie et la fusion à haute fréquence sur un cœur et caméra/ML sur l’autre. Donnez à la fusion/contrôle une priorité élevée et une pile explicite. Utilisez esp_timer_get_time() pour les timestamps en microsecondes et les journaux de latence par étape.

- Ultrasoniques avec RMT: Pilotez les déclencheurs et capturez les échos en matériel pour une précision en microsecondes sans attendre en veille. Aléatoires les déclenchements d’échelonnement entre les capteurs pour éviter les interférences croisées.

- E/S ToF/LiDAR: Exécutez le VL53L1X en mode continu sur I2C à 400 kHz ou 1 MHz (là où supporté) pour minimiser le surcoût et la gigue. Stream le TF‑Luna sur UART avec DMA.

- Odométrie et actionnement: Alimentez les codeurs de roue dans le PCNT et pilotez les moteurs via le MCPWM. La performance de freinage fait partie de l’équation de sécurité; un timing précis est obligatoire.

- Caméra sur S3: Utilisez esp32‑camera avec LCD_CAM DMA; capturez en niveaux de gris à QQVGA/QVGA avec double tampon. Conservez les buffers de frame dans le PSRAM si nécessaire, mais traitez les blocs dans la SRAM pour préserver l’efficacité du cache.

- Hygiène Tiny‑ML: Intégrez TFLM avec les kernels ESP‑NN; épinglez les arènes d’activation à la SRAM interne; évitez les allocations dynamiques dans la boucle en temps réel; placez les poids dans la flash/PSRAM si les empreintes d’activation restent sur puce; profilez sur le matériel cible pour confirmer les accélérations des opérateurs.

- CV Classique: Profitez de ESP-DSP pour des filtres rapides, des gradients, et une réduction; limitez le traitement aux régions d’intérêt (par ex. le champ de vision central-bas où les collisions imminentes se produisent).

Ces modèles gardent l’acquisition de données par capteurs, la fusion, et le contrôle dans des budgets déterministes tout en laissant la caméra/ML coexister sans affamer les tâches de sécurité.

Un Protocole d’Évaluation Standardisé pour des Résultats Comparables

Faire du benchmarking de la perception sans protocole est un bon moyen de se tromper. Une méthodologie pratique et reproductible inclut:

- Parcours et objectifs: Poteaux statiques (2–5 cm), panneaux plats à 15–75° d’incidence, noir mat, acrylique/verre transparent, tissu mou, courses de couloir à 0,5–1,0 m de largeur, et surplombs bas à 20–30 cm. Défis dynamiques: mannequin traversant à 0,5–1,5 m/s, pendule en mouvement, et trajectoires de rovers se croisant.

- Éclairage et interférences croisées: Fluorescent/LED en intérieur, basse luminosité, et patchs solaires; extérieur nuageux et plein soleil. Échelonnez les déclenchements ultrasoniques pour tester la gestion des interférences croisées.

- Conception des essais: Paramétrez la vitesse à 0,3, 0,6, 1,0, 1,5, et 2,0 m/s. Effectuez ≥30 essais par configuration pour estimer les faux positifs et négatifs avec intervalles de confiance. Évaluez par étapes: seul capteur vers l’avant; multi-capteurs; fusion; avec vision augmentée; à travers ESP32, S3, et C3 où possible.

- Vérité terrain: Caméra au-dessus avec AprilTags sur le rover et obstacles, traitée à ≥60 fps pour récupérer les trajectoires; synchronisez avec un flash visible sur appareil ou un clap; utilisez éventuellement NTP/PTP si le Wi‑Fi est disponible. Journalisation redondante de l’encodeur de roue via PCNT.

- Métrologie et journalisation: Mesurez la latence de détection depuis l’entrée dans la zone de danger vérité terrain jusqu’à la première détection sur appareil; calculez les taux FP/FN, la distance de détection fiable par matériau/angle, la vitesse maximale sûre par rapport à la distance d’arrêt, l’utilisation du CPU par tâche, l’empreinte mémoire (y compris le modèle TFLM/arène), et l’énergie via un shunt en ligne ou un compteur de puissance USB. Conservez en CSV/CBOR horodaté avec pose, vitesse, valeurs brutes/filtrées des capteurs, drapeaux de détection, décisions, CPU%, mémoire tampon libre, et latence du modèle. Stockez les images de caméra de manière éparse avec des hachages; conservez toujours de petites vignettes ou masques pour les sorties ML.

- Harnais de lecture: Ingerer les journaux et la vérité terrain hors appareil; recalculer la détection avec des paramètres alternatifs; produire des courbes ROC/PR et des histogrammes de latence. Garder les manifestes de scénario (JSON), sdkconfig, les indicateurs de construction, et les scripts de flash en contrôle de version pour reproduire.

Configurations Recommandées par Objectif et Budget

- Minimal, très faible coût (n’importe quelle variante ESP32): Deux ultrasoniques inclinés plus un capteur IR à courte distance; seuils avec hystérésis et une grille d’occupation de 12 secteurs. Une réponse inférieure à 30 ms est typique sur le chemin de télémétrie, soutenant environ 0,6–1,0 m/s avec des marges conservatrices. Attendez-vous à un risque de manque plus élevé sur les cibles angulaires/molles; validez attentivement.

- Base rapide et robuste (ESP32 ou S3): TF‑Luna vers l’avant, deux ultrasoniques inclinés, optionnellement VL53L1X sur les côtés. Seuils, filtrage alpha-bêta par secteur, et occupation avec décroissance temporelle délivrent une latence de détection vers l’avant de 5–20 ms et de faibles taux de faux négatifs en intérieur et extérieur, permettant 1,5–2,0 m/s avec des marges d’arrêt mesurées.

- Avec vision augmentée (ESP32‑S3): Ajouter OV2640 en niveaux de gris QQVGA; exécuter des contours/flux classiques pour l’espace libre et éventuellement un détecteur d’obstacles tiny‑ML; fusionner avec les preuves sectorielles. Attendez-vous à 60–110 ms de bout en bout, une meilleure gestion du verre et des obstacles fins, et 30–70% d’utilisation CPU de S3 si les tampons d’activation ML restent en SRAM.

Risques, Embûches, et les Atténuations Qui Comptent

- Interférences croisées et résonances ultrasoniques: Aléatoirez le timing des déclenchements, utilisez des temporisations RMT, appliquez des contrôles de largeur d’écho, et exigez une confirmation sectorielle sur de courtes fenêtres.

- Cas limites ToF/LiDAR: Surveillez les drapeaux de statut/saturation de portée; ajustez les budgets temporels ou les poids de fusion selon les conditions ambiantes; attendez-vous à une réduction de la portée sous une forte lumière solaire ou sur du verre/surfaces très sombres.

- Variance de la caméra: Verrouillez l’exposition et le gain pour stabiliser la latence; contraignez le traitement aux régions centrales-inférieures de l’image; méfiez-vous du flou de mouvement et des conditions de faible luminosité.

- Fiabilité du tiny-ML: Évitez l’allocation dynamique à l’intérieur de la boucle; épinglez les arènes d’activation à la SRAM interne; profilez les opérateurs sur la cible pour confirmer les accélérations ESP‑NN; dimensionnez les modèles pour s’adapter aux budgets d’activation SRAM.

- Planification en temps réel: Assignez des priorités FreeRTOS explicites et une affinité des cœurs; mesurez la latence dans le pire des cas avec esp_timer sous charge; gardez l’E/S sur les chemins DMA; évitez le PSRAM pour les tenseurs chauds lorsque c’est possible.

Quelle Variante Choisir et Pourquoi Cela Change Votre Mélange d’Algorithmes

L’ESP32‑S3 est le choix évident pour la fusion multi-capteurs augmentée par la CV classique basée sur caméra ou le tiny-ML. Les instructions SIMD/NN, le DMA LCD_CAM, et la disponibilité solide du PSRAM augmentent le plafond de ce qui s’intègre à l’intérieur de 50 à 100 ms sans affamer la boucle de sécurité. L’ESP32 classique brille pour la télémétrie multi-capteurs et la fusion; le travail caméra est possible avec un réglage minutieux et des taux de frame plus bas; tiny-ML devrait être limité à de très petits classificateurs avec des temps d’inférence plus longs. L’ESP32‑C3 excelle dans la télémétrie et fusion robustes, sans vision; si la sémantique est nécessaire, envisagez un coprocesseur.

Variantes ESP32 en Un Coup d’Œil

| Aspect | ESP32‑C3 | ESP32 (classique) | ESP32‑S3 |

|---|---|---|---|

| Points forts CPU/accélération | Monocœur RV32IMC @160 MHz; pas de caméra parallèle | Double cœur Xtensa LX6 @240 MHz; I2S/caméra parallèle via esp32‑camera | Double cœur Xtensa LX7 @240 MHz; SIMD/NN; DMA LCD_CAM; USB‑OTG |

| Algorithmes mieux adaptés | Seuils, occupation sectorielle, fusion avec TF‑Luna/ToF; pas de vision/ML | Télémétrie multi-capteurs + fusion; caméra limitée et petits classificateurs | Télémétrie + fusion plus arêtes/flux classiques ou tiny‑ML à QQVGA/96×96 |

| Faisabilité pour moins de 100 ms | Oui (basée sur la télémétrie) | Oui (basée sur la télémétrie; marginal pour vision/ML) | Oui (basée sur la télémétrie et la caméra) |

| CPU typique pour le pipeline | <25% (5–7 capteurs @50–100 Hz) | <30–50% (plus charge de la caméra si utilisée) | <30–70% avec caméra + tiny‑ML |

| Choix de capteurs (avant) | VL53L1X ou TF‑Luna | VL53L1X ou TF‑Luna | TF‑Luna ou VL53L1X + OV2640 |

| Risques clés | Contention monocœur | Variance de latence de la caméra | Complexité système; besoins en dataset ML |

La Conclusion pour les Constructions de 2026

La voie la plus rapide vers un rover plus sûr n’est pas un réseau neuronal monolithique; c’est une pile disciplinée qui exploite les forces de la famille ESP32. Placez un capteur de télémétrie haute fréquence au centre, ajoutez des ultrasoniques à large FoV, et fusionnez avec des filtres légers et une grille d’occupation courte. Sur ESP32‑S3, complétez avec la CV classique QQVGA ou un détecteur tiny int8 pour attraper les verres et les cas limites sans exploser le budget de latence. Épinglez les tâches sur les cœurs, poussez l’E/S à travers DMA, gardez les données chaudes en SRAM, et enregistrez tout avec des horodatages en microsecondes.

Ne sautez pas le protocole. Les parcours d’obstacles statiques et dynamiques, l’éclairage contrôlé, les tests d’interférences croisées ultrasoniques, la vérité terrain synchronisée AprilTag, et les scripts ESP‑IDF reproductibles transforment “ça marche sur mon banc” en données comparables. Reliez la latence de détection à la distance d’arrêt, puis fixez des limites de vitesse avec confiance.

C’est le guide de 2026: capteurs pragmatiques, boucles serrées, modèles modestes, et tests rigoureux. L’ESP32‑S3 rend la variante augmentée par caméra accessible; l’ESP32 classique et le C3 délivrent encore une sécurité axée sur la télémétrie fiable et légère. Avec la bonne configuration et la discipline de mesure, la détection d’obstacles en dessous de 100 ms n’est pas seulement possible sur les microcontrôleurs à petit budget—c’est reproductible. 🤖