Observabilidad de Precisión en los Colas para Tuberías Gemini: OpenTelemetry, SLIs de Transmisión y Benchmarking Resistente a Sesgos

Los problemas más difíciles en la inteligencia artificial en tiempo real no están en los modelos — están en las colas. En las tuberías de producción Gemini, unas pocas solicitudes lentas pueden hundir la experiencia del usuario, desestabilizar las transmisiones y consumir presupuestos de errores. Lo que importa no es un promedio, sino la forma de la distribución: los valores atípicos del TTFT, los bloqueos de transmisión, los acumulados de retraso en la cola y las mesetas de CPU/GPU que señalan un punto crítico de rendimiento entre el rendimiento y la latencia. A medida que los equipos pasan de las demostraciones a las tuberías siempre encendidas — abarcando transmisiones, entradas multimodales, llamadas de herramientas, RAG y mensajes de contexto largo — las señales deben ser precisas, causales y estadísticamente defendibles.

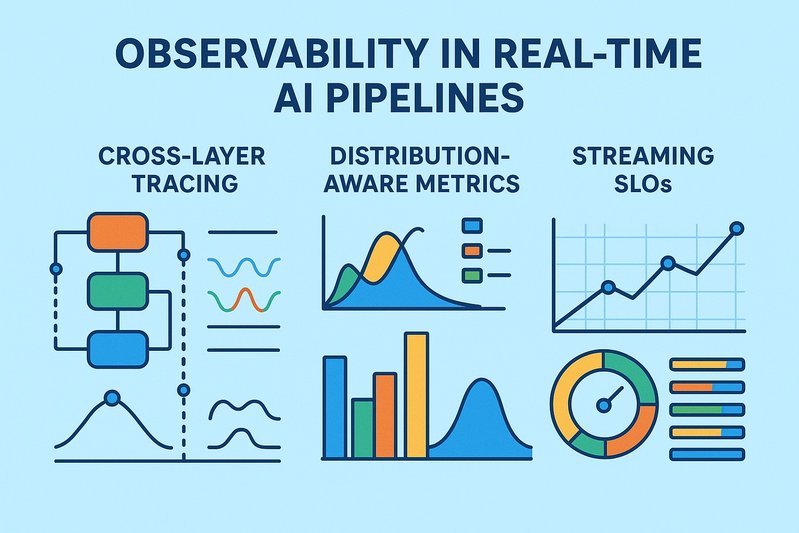

Este artículo detalla un plan práctico para la observabilidad de precisión en las colas y el benchmarking repetible de tuberías en tiempo real basadas en Gemini. Presenta SLIs de extremo a extremo (incluyendo TTFT/TTLT y la diferenciación entre frío y cálido), un modelo de trazas entre capas que une HTTP/gRPC con Pub/Sub y Kafka, un esquema de métricas consciente de la distribución para latencia y tokens, y una metodología que previene el sesgo de medición con llegadas de bucle abierto y salvaguardias contra omisiones coordinadas. También cubre la detección de puntos críticos de rendimiento entre rendimiento y latencia con telemetría de GPU/TPU/CPU/memoria, una taxonomía de errores que trata las respuestas bloqueadas por seguridad explícitamente, y consideraciones de rendimiento a nivel de interfaz al comparar la API de Gemini y Vertex AI bajo cuotas y límites de tasa iguales. Los lectores obtendrán un modelo funcional para la instrumentación, pruebas de rendimiento y toma de decisiones operativas que resiste el escrutinio estadístico.

Detalles de Arquitectura/Implementación

SLIs de extremo a extremo que preservan la fidelidad en las colas

El rendimiento de LLM en tiempo real depende de SLIs claros y sin ambigüedades:

- Percentiles de latencia (p50/p95/p99) medidos de extremo a extremo desde el envío del cliente hasta el último byte para no secciones de transmisión.

- Para la transmisión, definir el tiempo hasta el primer token (TTFT) desde el envío del cliente hasta el primer token emitido y el tiempo hasta el último token (TTLT) desde el envío hasta la finalización del flujo.

- Seguimiento de latencias frías vs. calientes para evitar mezclar los inicios fríos de la primera invocación con el tráfico en estado estable; los inicios fríos tienen sus propios contadores e, idealmente, sus propios SLOs.

- Los SLIs de rendimiento y capacidad incluyen QPS, flujos activos simultáneos y tokens por segundo durante las transmisiones. Donde la API devuelve metadatos de uso, alinea la contabilidad de tokens con la guía de tokens de Gemini y los límites de cuota.

La fiabilidad y disponibilidad deben segmentar las clases de error: transporte/tiempos de espera, 4xx vs 5xx, bloqueos de políticas de seguridad y respuestas de limitación de tasa. La disponibilidad es la relación entre los resultados exitosos durante la ventana de SLO; según la práctica SRE, excluya las fallas del lado del cliente, manteniendo las clases de limitación de tasa y seguridad visibles como resultados distintos.

Anatomía del rendimiento en transmisión para Gemini

La transmisión cambia tanto la experiencia del usuario como el modelo de medición. Gemini admite eventos enviados por el servidor (SSE) y transmisión a través del SDK. Comportamientos clave a capturar:

- TTFT es la señal más temprana de capacidad de respuesta; la transmisión normalmente reduce la latencia percibida al descargar tokens a medida que se generan.

- TTLT depende de la longitud de la salida, las invocaciones de herramientas al final del proceso y el análisis por parte del cliente. Mida los tokens por segundo como una tasa móvil por flujo activo y observe su estabilidad bajo concurrencia.

- La contrapresión del cliente importa: limite los flujos concurrentes y observe cómo el TCP/la red, el análisis del JSON/evento y las políticas de limitación afectan tanto al TTFT como a la TTLT en las colas.

Modelo de trazas entre capas para cosido causal

El rastreo distribuido debe unir las RPCs síncronas y la mensajería asíncrona para reconstruir la causalidad:

- Span raíz: solicitud cliente→gateway. Los atributos deben incluir model_name, model_version, interface (gemini_api|vertex_ai), mode (streaming|non_streaming), modalities (text|image|audio|video), input_tokens, expected_output_tokens y prompt_size_bytes.

- Spans secundarios: tokenización; seguridad/barreras de seguridad; la llamada a inferencia de Gemini; invocaciones de herramientas (HTTP/base de datos/vector) con latencia y estado; y recuperación de RAG (query_latency, k, index_version).

- Transmisión: representar el bucle de recepción como un span enriquecido con TTFT, recuentos por fragmento y observaciones de tokens por segundo.

- Mensajes: crear spans de publicación del productor (tema, message_id, partición/desplazamiento o ack_id) y spans de recepción/acuse del consumidor. Use enlaces de spans, no relaciones estrictas padre-hijo, a través de los límites de Pub/Sub y Kafka para preservar la causalidad para el fan-out y el procesamiento asíncrono.

- Propague W3C tracecontext a través de los encabezados HTTP/gRPC y los atributos de mensajes. Exporte a través del Recopilador de OpenTelemetry; use un backend centralizado para análisis sincronizado en el tiempo.

Esquema de métricas para colas conscientes de la distribución

Para diagnosticar las colas, confíe en histogramas diseñados para la precisión en los percentiles extremos:

- Histograma de latencia de extremo a extremo: request_latency_seconds{workload_id, interface, streaming, modalities}

- Histograma TTFT: ttft_seconds{workload_id, interface, modalities}

- Contadores de tokens: input_tokens_total, output_tokens_total; indicadores per-stream tokens_rate

- Progreso de la cola/transmisión: pubsub_undelivered_messages, pubsub_oldest_unacked_seconds; kafka_consumer_lag, partition_skew; dataflow_watermark_lateness_seconds

- Error/disponibilidad: request_errors_total{class}, availability_ratio

- Telemetría de recursos: cpu_usage, memory_working_set, gc_pause_seconds, gpu_utilization, gpu_memory_used, tpu_utilization y network I/O

- Costo: request_count_by_sku y cómputo descendente de costo por solicitud/token con datos de facturación unidos a contadores de solicitud (métricas específicas de costo no disponibles en este artículo)

Habilite ejemplares con IDs de traza en los cubos del histograma para que las muestras p99+ salten directamente a las trazas distribuidas relevantes para determinar la causa raíz. Este bucle ajustado —de gráfico a traza— acorta drásticamente el diagnóstico de las colas. 🔬

Tablas Comparativas

Interfaz y modo de respuesta: qué medir y por qué importa

Las siguientes comparaciones destacan qué mantener constante y qué observar al hacer benchmarking de tuberías basadas en Gemini. Apuntan a tendencias que debes validar bajo tus propias cargas de trabajo y cuotas.

| Dimensión | Configuración A | Configuración B | Enfoque de medición | Tendencias típicas (a verificar) |

|---|---|---|---|---|

| Interfaz | API de Gemini | Vertex AI | TTFT, latencia p95/p99, error/disponibilidad, comportamiento de limitación de tasa, atribución de costos | Paridad en latencia central bajo cuotas igualadas; las capas de Vertex AI controles empresariales e integran operaciones |

| Modo de respuesta | Sin transmisión | Transmisión | TTFT, TTLT, tokens/seg, contrapresión del cliente | La transmisión reduce TTFT; TTLT sigue la longitud de salida; observa el CPU de análisis del cliente y la concurrencia del flujo |

| Ingreso | Pub/Sub | Kafka | Retraso en la cola vs retraso del consumidor, latencia de extremo a extremo, señales de contrapresión | Ambos pueden alcanzar envolventes de baja latencia; las métricas operativas y las palancas de control difieren |

| Almacenamiento RAG | Motor de coincidencia | BigQuery Vector | Latencia de consulta p95/p99, frescura del índice, rendimiento | El Motor de coincidencias tiende a optimizar la latencia de ANNs a gran escala; BigQuery admite fusión SQL+vector |

| Almacenamiento RAG | AlloyDB pgvector | Motor de coincidencia | Latencia vs características transaccionales | AlloyDB pgvector se alinea con patrones transaccionales; el Motor de coincidencia es adecuado para recuperación a escala web |

| Aceleradores | Solo CPU | GPU/TPU adjunto | Puntos críticos de rendimiento vs latencia, utilización, costo/solicitud | Los aceleradores mejoran el rendimiento y reducen la latencia cuando la utilización se mantiene por encima de ~60–70% (los umbrales específicos varían) |

Mantén las cuotas y las políticas de limitación de tasa igualadas a través de las interfaces para una comparación justa. Registra las clases de limitación de tasa y el comportamiento de reintento como resultados de primera clase, no como ruido a filtrar.

Mejores Prácticas

Diagnóstico de colas: confianza en percentiles vinculados a ejemplos y trazas

- Usa cuantiles basados en histogramas (al estilo HdrHistogram o histogramas nativos) para estimar p95/p99/p99.9 sin perder la fidelidad en las colas.

- Adjunta ejemplares para que los gráficos percentiles se vinculen a trazas. Inspecciona los spans adjuntos a los valores atípicos de TTFT, las latencias de llamadas a Gemini o las picas de herramientas/RAG descendentes.

- Cuantifica la incertidumbre: calcula intervalos de confianza para las estimaciones de percentiles (por ejemplo, bootstrap). Reporta tamaños de efecto y límites de confianza al reclamar mejoras de rendimiento; evita anécdotas de ejecuciones individuales.

Carga resistente al sesgo: llegadas de bucle abierto y calentamiento vs estado estable

- Prefiere llegadas de bucle abierto (RPS constante o Poisson) para romper la retroalimentación entre el tiempo de servicio y la tasa de llegadas. Esto evita la omisión coordinada que de otro modo ocultaría la inflación real de la cola durante la sobrecarga.

- Separa el calentamiento de las ventanas de medición en estado estable; no mezcles frío y cálido en la misma distribución.

- Explora sistemáticamente el tamaño del contexto, el número/tamaño de los fragmentos recuperados y los tamaños de los medios. Registra el uso de tokens para correlacionar la sensibilidad de TTFT/TTLT con la longitud de la entrada y el fragmentado de transmisión.

Detección del punto crítico de rendimiento entre rendimiento y latencia y atribución de recursos

- Traza el rendimiento contra la latencia y busca el punto crítico donde los percentiles en las colas aumenten bruscamente. Superpone las utilizaciones de GPU/TPU/CPU, la presión de memoria, las pausas de GC y la I/O de la red.

- Usa métricas basadas en DCGM en GKE o Monitoreo de Cloud TPU donde sea relevante; correlaciona la utilización y la disponibilidad de memoria con la estabilidad de tokens por segundo y la desviación de TTFT.

- Para la transmisión, monitoriza los flujos activos concurrentes, la variación de tokens/seg y la sobrecarga de análisis de CPU del cliente. La contrapresión en el cliente puede aparecer como bloqueos de TTFT/TTLT o tokens caídos.

Salud de colas y marcas de agua para tuberías de transmisión

- Pub/Sub: los mensajes no entregados y la antigüedad de los no reconocidos más antiguos indican el retraso del consumidor y el riesgo para los SLOs de latencia.

- Kafka: el retraso del consumidor por grupo/partición, los conteos de ISR y el sesgo de particiones expone desequilibrios tempranos y atrasos.

- Dataflow/Beam: retraso de la marca de agua, tamaño de atrasos y señales de autoescalado muestran si las garantías de tiempo del evento están resbalando. El aumento del retraso de la marca de agua debería activar políticas de contrapresión o descargas aguas arriba.

Taxonomía de errores, disponibilidad e higiene de reintentos

- Clasifica explícitamente los errores: 4xx vs 5xx, tiempos de espera, bloqueos de políticas de seguridad y respuestas de limitación de tasa. Trata los bloqueos de seguridad como resultados reportables con contabilidad separada de fallos de transporte/servidor.

- La disponibilidad es la ratio de éxito sobre la ventana SLO, típicamente excluyendo fallas del lado del cliente pero incluyendo clases de limitación de tasa como señales de primera clase para la planificación de capacidad.

- Aplica retroceso exponencial con jitter; limita el tiempo total de reintento; prevén tormentas de reintento bajo fallos parciales. Muestra que las políticas de reintento no amplifican las colas o consumen presupuestos de error prematuramente.

Consideraciones a nivel de interfaz: API de Gemini vs Vertex AI

- Mantén igualados los payloads, los mensajes y las cuotas; registra las respuestas de limitación de tasa de manera distinta. Mide TTFT, TTLT/latencia de extremo a extremo, tokens por segundo, errores/disponibilidad y atribución de costos.

- Vertex AI típicamente incluye IAM, VPC-SC e integración de observabilidad que puede simplificar operaciones empresariales y atribución de costos. Realiza pruebas comparativas con esos controles habilitados si son parte de la postura de implementación requerida.

Rigor estadístico para demandas

- Usa tamaños de muestra suficientes para estimaciones robustas de p99/p99.9; no promedies percentiles.

- Replica ejecuciones y demuestra estabilidad entre réplicas. Exige mejoras solo cuando los intervalos de confianza no se superponen o cuando los tamaños de efecto son significativos en relación con los umbrales de SLO.

- Publica los criterios de pase/fallo antes de la prueba. Por ejemplo, p95 de extremo a extremo ≤ 800 ms para texto sin transmisión, p95 TTFT ≤ 200 ms para transmisión y p99 TTLT ≤ 2.5 s bajo condiciones de estado estable. Ajusta los valores según la carga de trabajo y modalidad.

Instrumentación y tableros que impulsan la acción

- Estandariza OpenTelemetry a través del cliente, el gateway, los orquestadores, las tiendas RAG/vector y las integraciones de herramientas. Propaga tracecontext a través de los límites RPC y de mensajería; exporta a un backend de trazas central.

- Usa métricas compatibles con Prometheus con ejemplares para latencia, TTFT, tokens por segundo, retraso en cola, retraso de marca de agua, clases de error, disponibilidad, inicios en frío y aciertos de caché. Exporta a un servicio Prometheus gestionado y conecta ejemplares a tu backend de trazas para investigaciones de cola de un solo clic.

- Construye tableros para percentiles de extremo a extremo, TTFT/TTLT, concurrencia, estabilidad de tokens por segundo, tendencias de clases de error y superposiciones de recursos/capacidad. Incluye enlaces rápidos desde los cubos p99 a trazas.

- Alerta sobre tasas de consumo de SLO usando políticas de ventanas múltiples (ventanas rápidas de 5m y más lentas de 1h). Agrega alertas de retraso en cola y retraso de marca de agua alineadas con SLOs de latencia. Las alertas de canario deben ser más estrictas y más sensibles.

Generación de carga y herramientas

- Usa herramientas y ejecutores capaces de bucle abierto para rutas HTTP/gRPC y de transmisión. Las opciones incluyen k6 para ejecutores de tasa de llegada con patrones de transmisión, Locust para flujos de usuarios pesados en orquestación (con formas personalizadas), Vegeta para RPS constante y herramientas CO-seguras como wrk2 donde sea aplicable.

- Respeta las cuotas publicadas y los límites de tasa específicos del modelo. Limita la concurrencia y los conteos de flujo para reflejar límites realistas del cliente; mide el impacto de CPU/red del cliente bajo tasas máximas.

Conclusión

La observabilidad de precisión en las colas para tuberías Gemini se basa en SLIs claros, trazas entre capas, y métricas conscientes de la distribución que sobreviven a la complejidad de las cargas de trabajo de transmisión, multimodal, RAG y de contexto largo. La piedra angular es el cosido causal impulsado por OpenTelemetry a través de HTTP/gRPC y mensajería, emparejado con cuantiles basados en histogramas y ejemplares para investigar rápidamente las colas p95/p99/p99.9. El benchmarking resistente al sesgo con llegadas de bucle abierto, separación de calentamiento y ejecuciones replicadas convierte el rendimiento anecdótico en evidencia. Y al detectar el punto crítico entre rendimiento y latencia y atribuirlo con telemetría de GPU/TPU/CPU/memoria/red, los equipos pueden tomar decisiones de capacidad y optimización con confianza.

Puntos clave:

- Define TTFT/TTLT, frío vs cálido, y clases de error explícitamente; mídelo con cuantiles basados en histogramas y ejemplares.

- Usa enlaces de spans para preservar la causalidad a través de Pub/Sub y Kafka; enriquece spans con atributos de herramientas/RAG y TTFT de transmisión.

- Evita la omisión coordinada con llegadas de bucle abierto; aísla el estado estable y calcula intervalos de confianza percentiles.

- Correlaciona puntos críticos de latencia con telemetría de GPU/TPU/CPU/memoria/red y señales de cola/marca de agua.

- Realiza pruebas comparativas de la API de Gemini frente a Vertex AI bajo cuotas y límites de tasa igualados; trata los resultados de límite de tasa y seguridad como métricas de primera clase.

Próximos pasos:

- Instrumenta rutas críticas de extremo a extremo con OpenTelemetry; habilita ejemplares y exportación de trazas centralizada.

- Levanta tableros para latencia/TTFT/TTLT con enlaces de trazas; agrega superposiciones de cola/retraso/marca de agua y recursos.

- Establece pruebas de carga de bucle abierto con una matriz de pase/fallo predeclarada; ejecuta experimentos replicados y publica ICs bootstrap.

- Calibra SLOs por carga de trabajo y modalidad; adopta alertas de tasa de consumo de ventanas múltiples y análisis de canario para lanzamientos seguros.

El beneficio es la claridad operativa. Con señales de cola precisas, pruebas estadísticamente defendibles y visibilidad entre capas, las tuberías Gemini pasan de prometedoras demostraciones a sistemas confiables y en tiempo real a escala. ⚙️