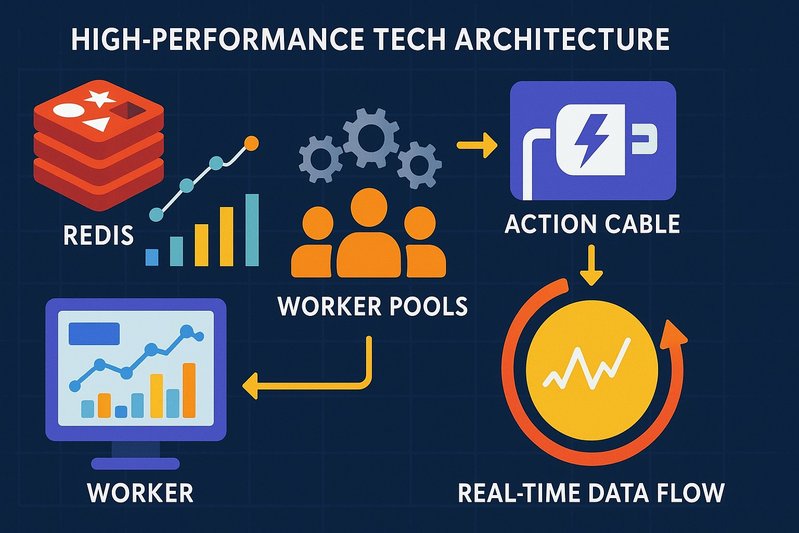

Redis-con Action Cable y Pools de Trabajadores Ajustados Impulsan el Rendimiento Determinista en Tiempo Real en Rails 7.1+

Rails en tiempo real ya no es simplemente “suficientemente bueno”: es rápido, predecible y operacionalmente maduro cuando se configura con intención. Habilitar permessage-deflate y los cuadros comprimibles reducen entre un 40-80% su carga de ancho de banda; ajustar un pool de trabajadores de Action Cable subdimensionado y el rendimiento aumenta 1.5-3× con p95/p99 más limpio; cambiar de PostgreSQL LISTEN/NOTIFY a Redis pub/sub y la capacidad de ventilación en múltiples nodos se incrementa entre 3-10×. Estos no son beneficios marginales. Son el resultado natural de que Rails 7.1+ aproveche un modelo simple de reactor más pool de trabajadores, un adaptador de Redis robusto y la ergonomía de Hotwire/Turbo Streams que trasladan la costosa renderización fuera de la vía principal.

Este análisis técnico en profundidad explica cómo la arquitectura de Action Cable se traduce en una disciplina de latencia al final, qué ofrece el adaptador de Redis en la práctica y por qué LISTEN/NOTIFY sigue siendo de nicho. Abarca el camino de descarga de Turbo Streams …_later, las concesiones de la compresión WebSocket y las realidades de la contrapresión y los consumidores lentos. También cubre la corrección del ciclo de vida de suscripción, patrones de eficiencia del lado del cliente y cómo interpretar la latencia p50/p95 y los techos de rendimiento para evitar perseguir el cuello de botella equivocado. Espere ejemplos prácticos de configuración y tablas que expliciten las concesiones.

Detalles de Arquitectura/Implementación

El modelo reactor-hilo y por qué doma la latencia al final

Action Cable separa las preocupaciones de manera clara: un bucle de I/O WebSocket no bloqueante maneja los cuadros, mientras que un pool de trabajadores Ruby ejecuta las devoluciones de llamada de canal—suscripción, cancelación, realizar—y procesa los mensajes entrantes. El pool de trabajadores por defecto es intencionalmente pequeño (comúnmente alrededor de 4), lo cual es amigable para aplicaciones pequeñas pero una responsabilidad bajo una ventilación explosiva. Cuando el pool es subdimensionado, las colas de trabajo se acumulan y las latencias p95/p99 se inflan a pesar de un reactor de I/O aparentemente inactivo.

flowchart TD;

A[WebSocket I/O Loop] -->|maneja| B[Frames];

A --> C[Pool de Trabajadores];

C -->|ejecuta| D[Devoluciones de Llamada de Canal];

D --> E[Mensajes Entrantes];

C -->|despliega| F[Hilos];

F -->|procesa| G[Colas de Trabajo];

G --> H[Latencia al Final];Este diagrama de flujo representa el modelo reactor-hilo de Action Cable, ilustrando cómo el bucle de I/O WebSocket interactúa con los pools de trabajadores, ejecuta devoluciones de llamada de canal y procesa mensajes entrantes para gestionar de manera efectiva la latencia al final.

Dimensione correctamente el pool, y la latencia al final vuelve a ser predecible. Aumentar un pool demasiado pequeño a 8-16 hilos generalmente produce un aumento de rendimiento de 1.5-3× y reduce el p95 hasta que se alcanza la siguiente restricción (CPU, Redis o NIC). Sin embargo, sobredimensionar puede salir contraproducente: la contención de hilos aumenta y los puntos finales HTTP coubicados pueden verse privados si Action Cable comparte un clúster Puma.

La configuración es sencilla:

# config/environments/production.rb

config.action_cable.worker_pool_size = 8Combine eso con un Puma sensatamente aprovisionado—trabajadores ≈ núcleos de CPU, 8-16 hilos por trabajador, preload_app!—y obtendrá concurrencia predecible para cargas de trabajo mixtas HTTP + WebSocket. Muchos equipos también aíslan Action Cable en su propio Puma para evitar la interferencia de tráfico cruzado cuando los picos en tiempo real ocurren.

Redis pub/sub: lo que ofrece (y lo que no)

El adaptador de suscripción de Redis es el camino de grado de producción para Action Cable de múltiples nodos. Usa Redis pub/sub para la coordinación entre procesos, soporta TLS y autenticación vía URL, y tiene un comportamiento de reconexión bien entendido. Con un Redis dedicado para tráfico pub/sub, la latencia de publicación-a-recepción es típicamente de milisegundos de un solo dígito con baja variación; más de 10k mensajes por segundo a través de nodos es común antes de que el CPU o los NICs se conviertan en el limitante. Críticamente, Redis evita el límite de carga útil ~8 KB de PostgreSQL NOTIFY y no consume el pool de DB de su aplicación, razón por la cual la capacidad de ventilación para cargas medianas/grandes aumenta por un factor de más o menos 3-10× en configuraciones de múltiples nodos.

En términos operativos, el failover o las particiones de red dejarán caer suscripciones; el adaptador se resuscribe al reconectar. Usar TCP keepalives, tiempos de espera de cliente apropiados y una instancia dedicada mejora la recuperación y previene tormentas de reconexión. Las garantías específicas de entrega más allá de la semántica pub/sub no están detalladas aquí; trate Redis pub/sub como una ventilación de alta velocidad y mejor esfuerzo, en vez de una cola duradera.

Habilítelo con:

# config/cable.yml

production:

adapter: redis

url: <%= ENV["REDIS_URL"] %>

channel_prefix: myapp_productionPostgreSQL LISTEN/NOTIFY: adecuado, pero limitado

LISTEN/NOTIFY mantiene una conexión DB persistente por proceso del servidor, compite por el pool de DB bajo carga y limita las cargas útiles a aproximadamente 8 KB. La latencia y el rendimiento son adecuados para despliegues pequeños o de un solo nodo con un ventilador modesto y mensajes minúsculos. Más allá de eso, el acoplamiento operativo a la base de datos y el límite de carga útil lo convierten en una mala opción para la transmisión en tiempo real a gran escala. El camino es simple—establezca el adaptador: postgresql—pero el límite llega rápidamente; la mayoría de los sistemas de producción se benefician de Redis.

Turbo Streams: descargando la renderización para proteger la vía caliente

Los Turbo Streams renderizados por servidor reducen la complejidad de la CPU del cliente y de JavaScript al entregar operaciones declarativas en el DOM. Pero renderizar ERB en la vía caliente de WebSocket puede bloquear el reactor cuando las actualizaciones pican o la ventilación aumenta. Los ayudantes …_later resuelven esto moviendo la renderización a trabajos en segundo plano:

class Message < ApplicationRecord

after_create_commit -> { broadcast_append_later_to "room_#{room_id}" }

endEste cambio mejora materialmente la latencia al final en escenarios de ventilación 1:100+ con ráfagas. Espere una reducción del 20-50% en p95 cuando se renderizan parciales pesados a través de variantes …_later, cambiando el bloqueo inicial de la línea por latencia de la cola de trabajos que es típicamente más pequeña y más fácil de absorber.

Compresión: el espacio de intercambio ancho de banda/CPU de permessage-deflate

Cuando ambos extremos lo soportan, el websocket-driver subyacente negocia permessage-deflate automáticamente—no se requieren cambios en la aplicación. Para cuadros comprimibles como JSON o HTML de turbo-stream, el ancho de banda cae entre un 40-80%, lo que a menudo eleva mensajes sostenibles por segundo entre un 10–30% antes de que se tome control por otro cuello de botella. La sobrecarga de CPU es modesta para mensajes pequeños y crece con cuadros más grandes (por ejemplo, alrededor de 32 KB), así que mida antes y después. Si la negociación falla o un cliente no soporta la extensión, la conexión procede sin comprimir sin interrupción.

Contrapresión y consumidores lentos en WebSocket/TCP

TCP aplica contrapresión. Si los búferes de envío del kernel se llenan, las escrituras se ralentizan, y los consumidores lentos pueden crear bloqueo inicial en la línea que se propaga. Action Cable no aplica limitación de tasa a nivel de aplicación, así que añada barandillas para eventos entrantes y mantenga el trabajo por mensaje pequeño. Un patrón simple utiliza contadores de Redis para controlar:

def perform(action, data)

key = "cable:ratelimit:#{current_user.id}:#{action}:#{Time.now.to_i}"

if Redis.current.incr(key) > 5

reject

else

Redis.current.expire(key, 1)

# procesar mensaje

end

endEn el lado de la salida, prefiera actualizaciones pequeñas y comprimibles, mueva la renderización costosa a …_later y observe los canales cuyos consumidores consistentemente se retrasan; esos son candidatos para la consolidación o el muestreo.

Corrección del ciclo de vida de suscripción y costo de reconexión

El manejo del ciclo de vida correcto mantiene el uso de recursos predecible y las reconexiones económicas:

- Llame a stop_all_streams en unsubscribe para evitar suscripciones restantes.

- Mantenga la autorización de conexión ligera—cookies firmadas y un lookup de current_user de una sola vez—para que las tormentas de reconexión no golpeen su DB.

- Alinee los tiempos de espera inactivos del proxy/balanceador de carga con el intervalo de ping del servidor (comúnmente igual o superior a 60 segundos) y habilite sesiones adhesivas. Los tiempos de espera demasiado cortos cortan los sockets inactivos y desencadenan ciclos de reconexión evitables.

Tablas Comparativas

Adaptadores Redis vs. PostgreSQL para la emisión en abanico de Action Cable

| Dimensión | Adaptador Redis pub/sub | PostgreSQL LISTEN/NOTIFY |

|---|---|---|

| Límites de carga útil | Sin límite a nivel de adaptador típico para pub/sub | ~8 KB límite de payload de NOTIFY |

| Ventilación en múltiples nodos | Alta; 3-10x más capacidad de maniobra en comparación con PG a escala | Limitada; compite con el pool de DB |

| Varianza de latencia | Baja cuando Redis es dedicado | Mayor varianza bajo carga de DB |

| Acoplamiento de recursos | Instancia Redis dedicada recomendada | Consume una conexión de DB por proceso del servidor |

| Comportamiento de reconexión | Semánticas de resuscripción estables; configure keepalives/tiempos de espera | Ligada a la estabilidad de la conexión de DB |

| Adecuación operativa | Producción en múltiples nodos; cargas útiles medianas/grandes | Aplicaciones pequeñas, de baja escala o de un solo nodo |

Características que marcan la diferencia

| Palanca | Impacto típico | Advertencias |

|---|---|---|

| Aumentar worker_pool_size de ~4 a 8–16 | 1.5-3× de rendimiento; se reduce p95/p99 hasta que CPU/Redis/NIC se saturan | Sobredimensionar puede empeorar p95 y dañar la latencia HTTP si se comparte Puma |

| Usar ayudantes …_later de Turbo Streams | −20-50% p95 en ventilación de 1:100+ con parciales pesados | Agrega latencia de cola de trabajos; asegúrese de que los trabajos en segundo plano estén saludables |

| Habilitar permessage-deflate | −40-80% ancho de banda; +10-30% mensajes sostenibles/segundo | El costo de CPU aumenta con cuadros grandes; medir antes/después |

| Cambiar de PG a adaptador Redis | Capacidad de maniobra de ventilación 3-10× más alta; evita la contención del pool de DB | Requiere Redis dedicado y disciplina de failover |

Mejores Prácticas

Ajustar la concurrencia en función de su CPU y carga de trabajo

- Comience con worker_pool_size en 8–16 cuando haya espacio en CPU, luego ajuste usando métricas reales de latencia y rendimiento.

- En Puma, use trabajadores≈núcleos, hilos 8–16, y preload_app!. Si los puntos finales HTTP sufren durante los picos en tiempo real, aísle Action Cable en su propio Puma.

Hacer que las transmisiones sean pequeñas, comprimibles y fuera de la vía principal

- Use Turbo Streams para cambios en el DOM renderizados por servidor; prefiera variantes …_later para actualizaciones con renderización pesada.

- Consolidar o muestrear ráfagas cuando el mismo stream recibe actualizaciones frecuentes.

- Mantenga las cargas útiles comprimibles (JSON, fragmentos HTML) para beneficiarse de permessage-deflate.

Tratar a Redis como un transporte de primera clase

- Ejecutar un Redis dedicado para el tráfico pub/sub; evitar mezclar con cargas de trabajo pesadas de clave/valor o configuraciones fsync innecesarias.

- Configure TCP keepalive y tiempos de espera del cliente para acelerar la detección de fallos.

- Monitorear la CPU y la utilización de red de Redis junto a las métricas de la aplicación.

Fortalecer el borde

- Configurar el balanceador de carga para pasar Upgrade: websocket, habilitar sesiones adhesivas y establecer tiempos de espera inactivos por encima del intervalo de ping.

- Vigilar las tasas de reconexión; los picos inesperados a menudo se remontan a tiempos de espera inactivos o redespliegues de LB.

Incorporar control de flujo y barandillas

- Limitar la tasa de eventos entrantes usando contadores Redis o patrones de middleware.

- Mantener el trabajo por mensaje de canal pequeño; las operaciones pesadas pertenecen a trabajos en segundo plano.

- Rastrear consumidores lentos y ajustar estrategias de transmisión según sea necesario.

Observar lo que importa y ajustar de manera iterativa

- Suscribirse a notificaciones de Active Support para duraciones por canal y por acción, profundidades de cola, recuentos de conexión y errores.

- Agregar trazabilidad alrededor de las acciones de ejecución del canal y las llamadas de transmisión; correlacionar con la instrumentación del cliente Redis para localizar la latencia.

- Validar cualquier cambio de ajuste comparando latencia p50/p95, mensajes entregados/seg a una tasa de caída/error fija, ancho de banda de salida y tasas de reconexión.

Mantener el ciclo de vida y la autenticación económicas

- Asegurarse de que stop_all_streams se ejecute en unsubscribe para prevenir filtraciones.

- Usar cookies firmadas/encriptadas y una búsqueda de usuario memoizada al conectarse; evitar verificaciones de DB por mensaje.

- Restringir allowed_request_origins para reducir la sobrecarga de negociación y la superficie de abuso.

Ejemplos Prácticos

# config/environments/production.rb

# Comience conservadoramente, luego ajuste con métricas

config.action_cable.worker_pool_size = 12# config/cable.yml

production:

adapter: redis

url: <%= ENV["REDIS_URL"] %> # supports TLS/auth via URL

channel_prefix: myapp_production# Turbo Streams: descarga de renderización pesada

class Message < ApplicationRecord

after_create_commit -> { broadcast_append_later_to "room_#{room_id}" }

end# Instrumentación para métricas

ActiveSupport::Notifications.subscribe(/action_cable/) do |name, start, finish, id, payload|

duration_ms = (finish - start) * 1000

# exporte conteos, duraciones, fallos, estadísticas por canal

end// cliente @rails/actioncable con valores predeterminados razonables

import { createConsumer } from "@rails/actioncable"

const consumer = createConsumer("wss://example.com/cable")

const channel = consumer.subscriptions.create(

{ channel: "RoomChannel", id: 42 },

{

connected() { /* listo */ },

disconnected() { /* retroceso automático y reintento */ },

received(data) {

// Agrupar actualizaciones DOM donde sea posible

requestAnimationFrame(() => {

// aplicar actualización (o dejar que Turbo Streams lo haga)

})

}

}

)Interpretando el Rendimiento: p50/p95, techos de rendimiento y cambios de cuello de botella

Centrarse en cambios que mejoren los mensajes entregados a una tasa de error/caída fija sin desestabilizar el comportamiento de reconexión:

- Rastrear la latencia de conexión-a-recepción (incrustar marcas de tiempo del servidor en las cargas útiles) y calcular p50/p95. Se espera que p95 se ajuste al aumentar worker_pool_size desde una línea base subdimensionada y al descargar la renderización a …_later.

- Medir los mensajes entregados/segundo bajo cargas constantes y explosivas. La compresión a menudo compra entre un 10–30% más de rendimiento antes de que el siguiente límite se manifieste.

- Monitorear el ancho de banda de salida. Con permessage-deflate, el ancho de banda típicamente cae entre un 40–80% en cuadros comprimibles; esto se traduce en menor utilización de NIC y más margen.

- Observar CPU en nodos de aplicación y Redis. A medida que se eliminan cuellos de botella (p. ej., saturación del pool de trabajadores), el siguiente surgirá—comúnmente CPU o red, a veces el propio Redis.

- Rastrear tasas de reconexión durante la operación normal y fallas inducidas (reinicio de Redis, drenaje de LB). Los keepalives/tiempos de espera adecuados y las sesiones adhesivas reducen los picos de reconexión y acortan la recuperación.

Use este ciclo para ajustar hacia sus SLOs: aumente el pool de trabajadores hasta que la CPU se acerque a límites seguros; mueva la renderización fuera de la vía caliente; habilite la compresión; confirme que Redis no esté contendido; y revise los tiempos de espera del balanceador de carga. Espere que las ganancias sean escalonadas—cada mejora desplazará el cuello de botella, no lo eliminará.

Conclusión

Rails 7.1+ proporciona a Action Cable una receta pragmática para un rendimiento determinista en tiempo real: mantenga I/O no bloqueante, empuje el trabajo a un pool de hilos dimensionalmente correcto, confíe en Redis pub/sub para ventilación cruzada en nodos, y use Turbo Streams para mover la renderización pesada fuera de la vía caliente. La compresión de WebSocket estira el ancho de banda, y el manejo disciplinado de la contrapresión mantiene a los consumidores lentos fuera de peligro. El manual operativo—sesiones adhesivas, tiempos de espera inactivos razonables, un Redis dedicado y métricas a través de notificaciones de Active Support—convierte estos bloques de construcción en p95/p99 predecibles y un comportamiento de reconexión saludable a escala.

Conclusiones clave:

- Ajuste primero el pool de trabajadores de Action Cable; a menudo proporciona las mayores mejoras en p95/rendimiento.

- Prefiera Redis pub/sub para ventilación en múltiples nodos; LISTEN/NOTIFY sigue siendo una opción a pequeña escala debido a los límites de carga útil y al acoplamiento de DB.

- Mueva transmisiones con renderizado pesado a …_later; protege el reactor y ajusta la latencia al final.

- Habilite permessage-deflate para intercambiar una modesta CPU por significativos aumentos en ancho de banda y rendimiento.

- Medir implacablemente: p50/p95, mensajes entregados/seg, ancho de banda de salida, CPU de Redis y aplicación, y tasas de reconexión.

Próximos pasos para los equipos:

- Pruebe su configuración actual, luego aumente worker_pool_size con espacio en CPU y vuelva a medir.

- Migre al adaptador de Redis si aún está usando LISTEN/NOTIFY.

- Audite las transmisiones de Turbo Streams y cambie las pesadas a variantes …_later.

- Verifique la negociación de permessage-deflate y la configuración de sesiones adhesivas/tiempos de espera de LB.

- Instrumente eventos de Action Cable y agregue trazabilidad para correlacionar la latencia de la aplicación, Redis y la red.

Con estas prácticas en su lugar, Rails en tiempo real escala a miles de conexiones concurrentes y tasas altas de mensajes mientras mantiene una latencia nítida y consistente—sin heroicas necesarias. 🚀